Алгоритмы поисковых систем постоянно усложняются, что стимулирует SEO-специалистов заниматься саморазвитием. Однако в стремительно меняющихся условиях не всегда удается избежать ошибок и предупредить обвал показателей в метрике.

На что обратить внимание в профилактических целях? И как исправить проблему, если просчет уже допущен? Рассмотрим частые промахи в СЕО.

1. Акцент на лендинг

В бизнес-среде бытует мнение, что одностраничники – самый эффективный инструмент продвижения. Их активно навязывают обучающие курсы, которые не смотрят дальше сиюминутной выгоды.

На практике лендинг серьезно ограничивает группу запросов, сужая ее до 12-15 ключевых фраз. То же самое происходит и с удовлетворением поисковых намерений пользователей (интентов). Одна страница позволяет учесть только одно ожидание клиента.

Чтобы запустить продвижение по более расширенному семантическому ядру, под каждую группу ключевиков потребуется отдельный лендинг. В таком случае каждая страница будет закрывать определенный интент.

Актуальная тенденция – использование разветвленной структуры сайта, которая обеспечит ему стабильный приток посетителей. Чем больше страниц – тем больше трафика из поисковых систем.

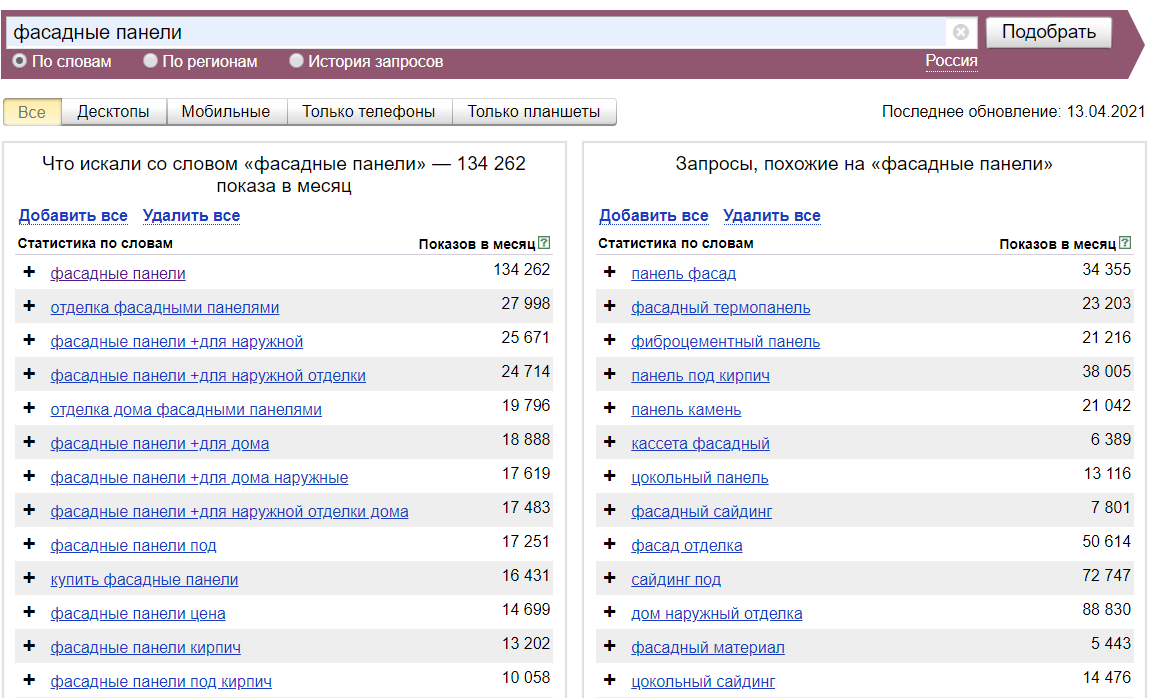

2. Ограниченное семантическое ядро

Распространенный недочет, тесно связанный с предыдущим. Такую ошибку часто делают специалисты, считающие, что нет смысла тратить время на максимальный сбор семантики. Они останавливаются на узком ядре ключевиков и строят работу только на этих запросах.

На самом деле независимо от типа проекта нужно как можно больше семантики. 1000 и более запросов – это не предел, а только минимум. Соответственно растет число посадочных страниц, точек выхода на сайт из поисковой выдачи, что ощутимо повышает шансы привлечь целевую аудиторию.

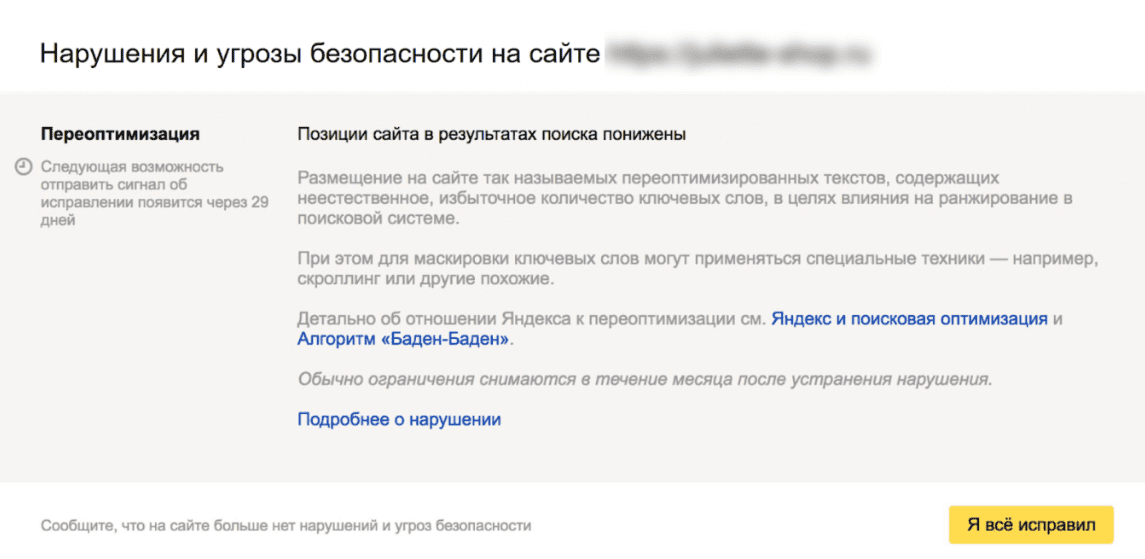

3. Некачественный контент (заимствованный, переспамленный, малоинформативный)

Нередка ситуация, когда подрядчик в ответ на запрос наполнения для продвигаемого ресурса получает от заказчика тексты с чужого сайта с незначительными поправками. Поисковые алгоритмы такой контент не приветствуют, что приводит к снижению позиций домена.

Еще одна проблема – уникальный контент слабого качества. Малоинформативные статьи с большим количеством воды, перенасыщенные ключами, не отвечающие ожиданиям пользователя, вряд ли попадут в ТОП выдачи. Если такого контента на ресурсе много, то он попадает под санкции алгоритмов Яндекс или Google (Баден-Баден, Панда, Фред).

Решение одно – наполнять страницы уникальными текстами, не перегруженными неестественными ключевыми фразами и не уходящими от темы.

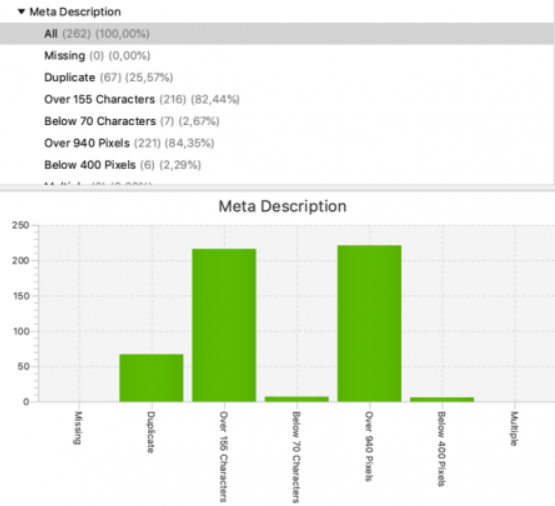

4. «Обнуление» метатегов

Метатеги – важный инструмент в ранжировании сайта поисковыми алгоритмами. Если они слетают, ресурс существенно снижает позиции в выдаче. Какие бывают причины?

- недавно проведенные технические работы;

- переезд на новый хостинг;

- добавление товаров через импорт;

- проблемы с подключаемым модулем, др.

Избежать ошибки с метатегами поможет резервное копирование, выполненное перед техническими работами. А по их окончании рекомендована проверка ключевых параметров с помощью узконаправленных сервисов (модуль «Радар» от Topvisor, инструменты Website Auditor и NetPeak Spider, др.). Вовремя обнаружив проблему, можно устранить ее без последствий для продвижения.

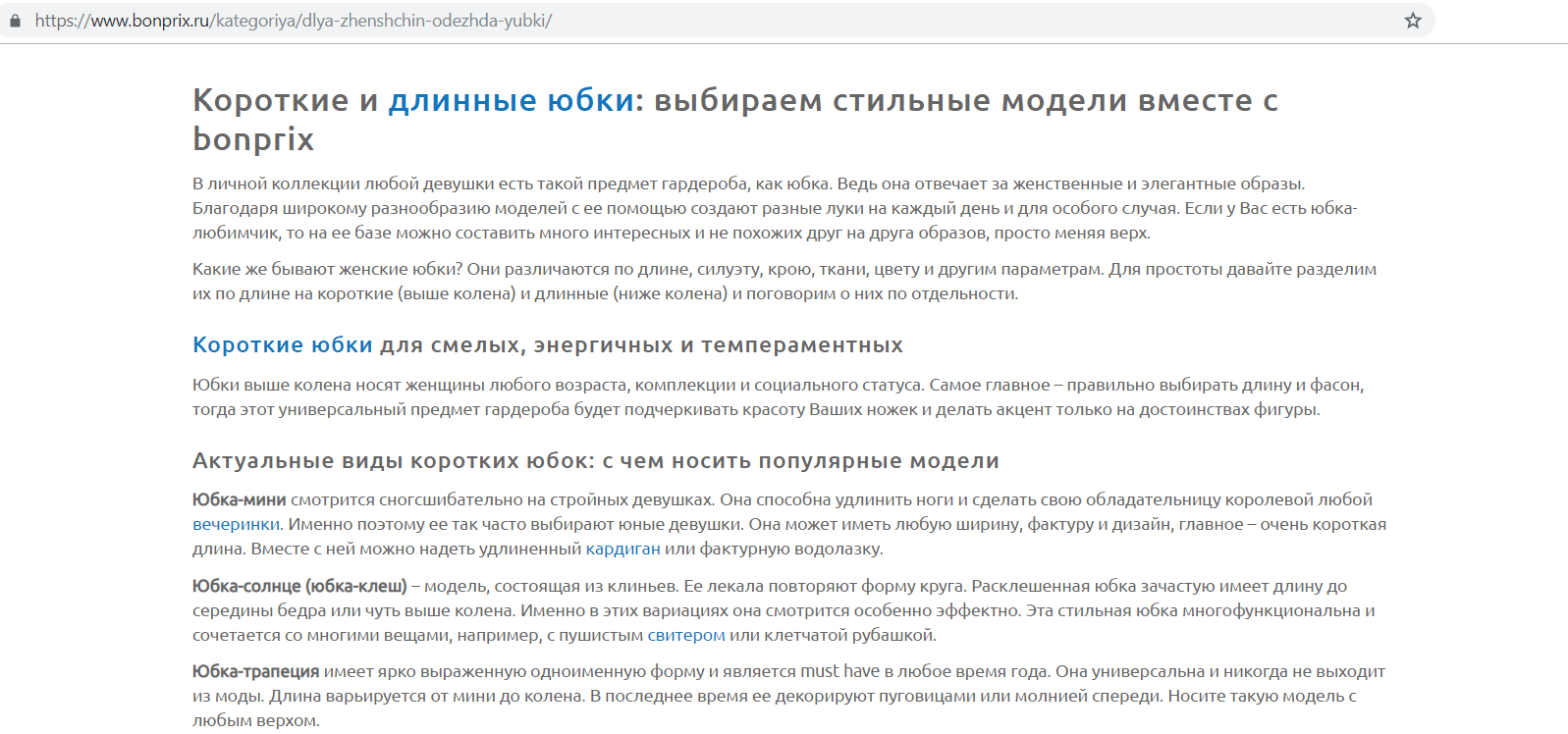

5. Перебор с контентом для интернет-магазинов

Распространено мнение, что для сайтов, продающих товары, нужны объемные тексты с ключами. Подразумевается, что для эффективного продвижения интернет-магазина необходимы полноценные статьи для каждой категории и уникальные подробные описания для товарных карточек.

На самом деле немногие покупатели читают эти тексты, что обесценивает работу по их созданию. К тому же за перебор с описательным контентом для категорий влечет санкции со стороны Баден-Баден.

Схожая ситуация наблюдается и с карточками товаров. Нет нужды делать их уникальными, если это стандартные позиции, которые представлены во многих интернет-магазинах. Можно воспользоваться шаблонными текстами от производителей.

6. Отсутствие цен

Серьезный промах, который часто можно встретить на сайтах услуг, где предполагается индивидуальный расчет стоимости.

Причины такого решения могут быть разными. Один владелец бизнеса опасается спугнуть клиента высокими расценками, другой, напротив, боится продешевить. А кто-то предпочитает скрыть денежную политику от конкурентов. Но результат одинаков: сайт по аналогичным поисковым запросам будет ранжироваться ниже.

Но выход есть. Если есть серьезные причины не оговаривать точную сумму, можно обозначить диапазон, стартовые расценки или выложить основной прайс.

7. Запрет в robots.txt

Ограничение допуска к ресурсу через «Disallow:/» в robots.txt на стадии разработки – стандартная практика. Но для уже функционирующего сайта означает проблемы с поисковой оптимизацией.

Такое случается, когда разработчики, завершая работы, забывают об открытии индексации или случайно ограничивают ее в процессе внедрения очередного дополнения. Также корректировки в robots.txt может внести недавно подключенный плагин или модуль.

Чтобы исключить проблему, не помешает периодически анализировать состояние ресурса в панелях вебмастеров.

8. Слабая индексация

Индексируя сайты, поисковые системы руководствуются т. н. краулинговым бюджетом. Он определяет количество страниц, которые будут добавлены в базу за один визит поискового робота. На сайтах с четкой структурой краулинговый бюджет расходуется эффективнее. На перегруженных ресурсах он тратится впустую.

Схожая ситуация наблюдается, если в проекте много «бесполезных» страниц (дублирующих, технических), на которые напрасно уходит краулинговый бюджет. Они отрицательно влияют на рейтинг сайта, не давая ему подняться на более высокие пункты в выдаче.

Чтобы не допустить потери трафика, необходимо скрывать «пустые» страницы от индексации и тщательно прорабатывать структуру ресурса.

9. Страница «404» с кодом «200»

Случается, что страница с ошибкой «404» отправляет серверу ответ с кодом «200», тем самым сообщая, что она открыта для индексации. Хотя на самом деле это не так.

Причины такого недоразумения кроются в некорректной работе сервера или движка. При этом страниц с неправильным сигналом может быть много, даже если число посадочных исчисляется десятками. Чтобы исключить такую ситуацию, периодически рекомендуется тестировать отклик сервера по ошибочным страницам.

10. Динамический контент и фильтры в поиске

Указанные страницы удобны для пользователя, но индексироваться не должны. Для поисковых систем динамический контент по сути является «мусором», который мешает оптимизации, а комбинации фильтров и вовсе могут исчисляться тысячами. Поэтому их обязательно скрывают от индексации, прописывая соответствующие директивы через robots.txt.

11. Отсутствие адаптации под смартфоны

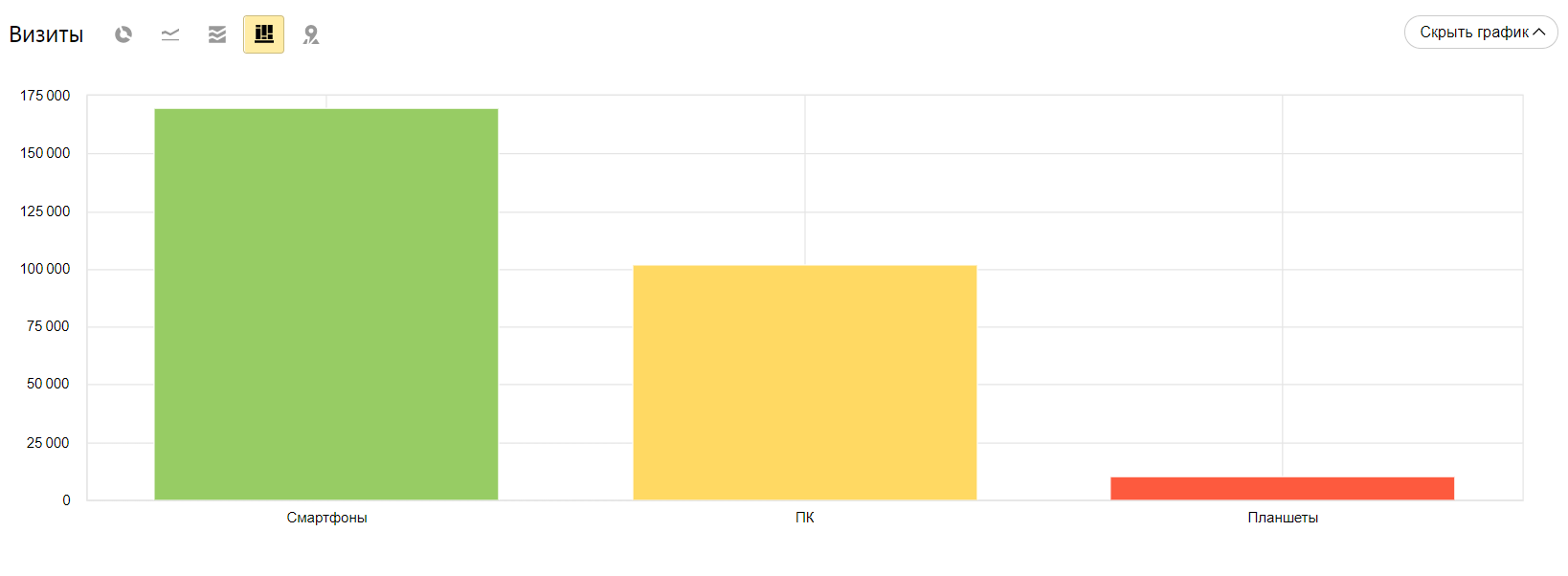

По информации Google более половины интернет-трафика потребляют владельцы мобильных устройств. По отдельным нишам в Рунете данный показатель превышает даже 70%.

Поисковые выдачи для смартфонов и компьютеров существенно отличаются. Причем для первой адаптивный дизайн входит в число основных факторов, влияющих на ранжирование сайта. Отражается этот момент и на действиях пользователей: если работа с сайтом через мобильный затруднена, растет динамика отказов, а конверсия стремиться к нулю.

12. Разный контент для смартфонов и PC

Адаптировать сайт под мобильные устройства можно несколькими путями:

- Через дизайн. Верстка ресурса предполагает легкость подстройки страниц под параметры экрана любого устройства, которым пользуется потребитель.

- Через динамическую версию для смартфонов. Запрос пользователя мгновенно оценивается с точки зрения используемого устройства. Если он посещает сайт со смартфона, то получает доступ к специальной версии для мобильных.

- Через поддомены. Пользователь, открывающий ресурс с мобильного устройства, перенаправляется с основной (десктопной) версии на отдельный поддомен.

Создавая версию для смартфонов, разработчики часто убирают определенные блоки, тем самым облегчая дизайн сайта и улучшая восприятие страниц. Но контент из-за таких корректировок может существенно измениться по сравнению с PC-вариантом.

Учитывая, что выдача Google работает по принципу приоритета мобильной версии, можно ожидать, что отсутствующий там контент просто не будет учитываться при ранжировании. Потому адаптация через дизайн является приоритетной при подстройке сайта под смартфоны.

13. Автоматизированная закупка ссылок

Некоторые ресурсы все еще пользуются автоматическим сбором ссылок для продвижения. Но, прогоняя сайт по полуживым форумам и каталогам, вы получаете минимум пользы. В то время как риск попасть под ограничения фильтра Минусинск возрастает в разы. Осторожно следует относиться и к коммерческим анкорам, определяемым поисковиками как неестественные.

14. Накручивание поведенческих факторов

Специализированные сервисы активно продвигают такую услугу, обещая мгновенный результат в продвижении сайта. Возможно, на краткий срок вы действительно повысите позиции проекта. Однако неизбежно будете обнаружены фильтрами, после чего надолго выпадете из выдачи.

Лучше не рисковать, а провести работу по естественному улучшению показателей – через исправление ошибок, усовершенствование юзабилити, повышение кликабельности сниппетов и т.д. В результате поведение пользователей изменится в положительную сторону без искусственных накруток.

15. Неправдоподобные поведенческие факторы

Предполагается, что чем дольше посетители задерживаются на ресурсе и чем большее число страниц открывают, тем лучше. Но это утверждение не всегда верно. Важно учитывать еще и тематический фактор, за которым следят поисковые системы. Есть ниши, где пользователь должен максимально оперативно получить информацию. Например, на сайтах по вызову эвакуатора или предоставлению экстренной психологической помощи, где нужно быстро найти номер телефона, чтобы решить проблему.

Если на таких ресурсах пользователь проводит слишком много времени, Яндекс может решить, что они не отвечают потребностям аудитории.

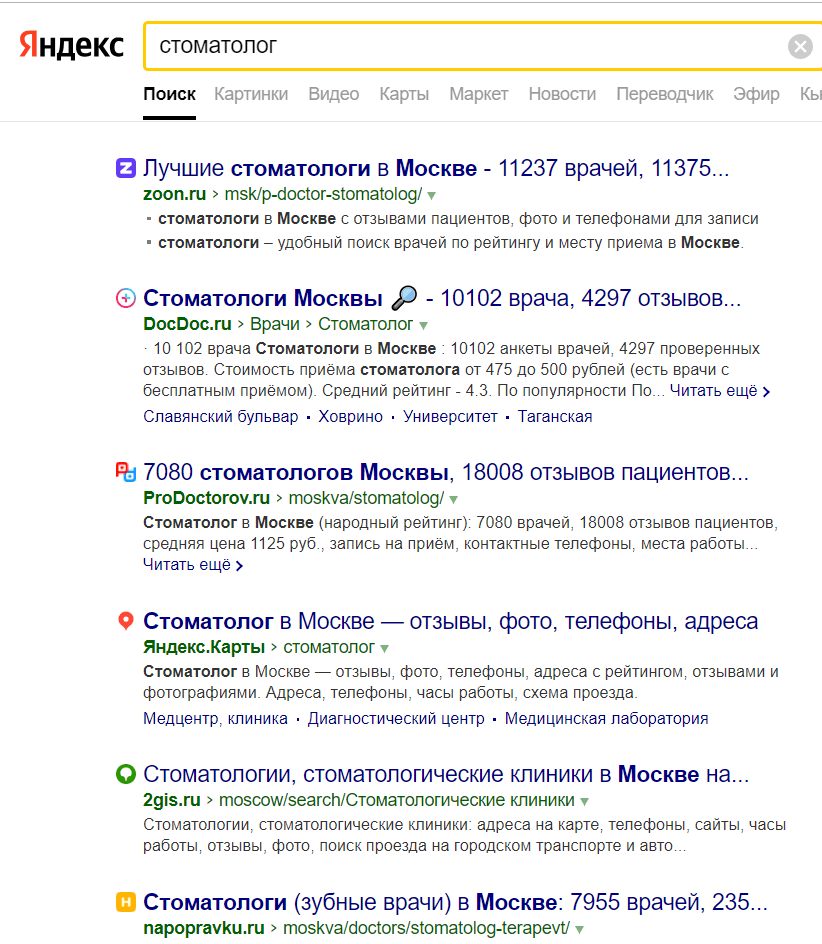

16. Продвижение по запросам агрегаторов

Семантическое ядро, на котором строится продвижение ресурса, может включать запросы, уже «захваченные» каталогами и сервисами самих поисковых систем. Пытаясь конкурировать за трафик с агрегаторами, вы только напрасно потратите время.

Разумнее – изменить стратегию. Используйте сайты-агрегаторы как связующее звено между пользователем и собственным ресурсом. Все, что требуется, это создать в их каталоге страницу под собственный бизнес и попытаться войти в ТОП по выбранной категории.

17. Игнорирование брендовых запросов

Прежде чем сделать покупку или воспользоваться услугой, большая часть потребителей изучают рекомендации других людей. Вариаций запросов по принципу «бренд + отзывы» может быть очень много. Кто-то ищет сведения о фирме как о работодателе, кто-то оценивает опыт использования того или иного товара. И этими данными можно эффективно управлять, используя их как ключи для продвижения. Корректируя результаты поисковой выдачи под собственный бренд, вы легко добьетесь попадания ресурса в ТОП-10, поскольку конкуренция здесь, как правило, минимальна.

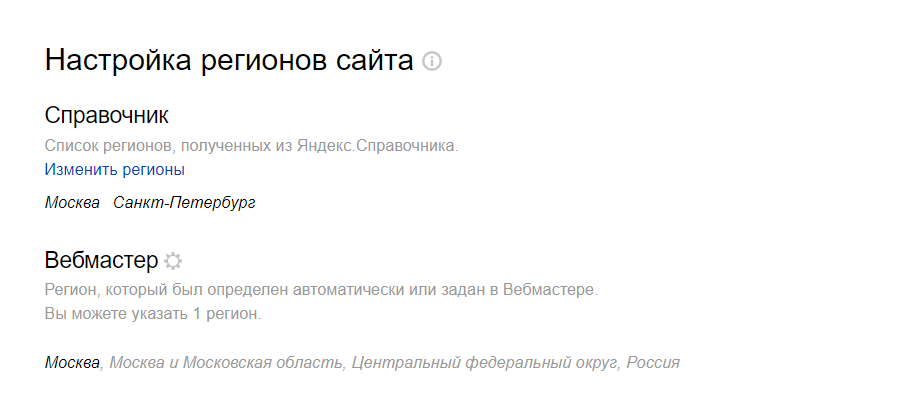

18. Отсутствие региона продвижения

Распространенная ошибка, которая может существенно подпортить позиции. Если поисковые алгоритмы неверно определяют географическую принадлежность проекта, он недополучает показы по запросам с привязкой к региону.

Укажите локацию в настройках Вебмастера через Яндекс Справочник до того, как приступить к продвижению.

19. Продвижение PDF в ущерб сайту

Тенденция использования PDF-страниц для роста конверсии постепенно уходит в прошлое. Кто-то еще рассматривает ее как добавочную точку притяжения трафика, но отдача от такого продвижения минимальна. Диапазон использования PDF-страниц ограничен: по сути это документ, который нельзя настроить. В него невозможно интегрировать СТА и подключать технические средства для управления им проблематично. Поэтому разумнее отказаться от PDF в пользу классических HTML-страниц.

20. Неправильная настройка целей на формы

Приводит к сложностям с мониторингом эффективности продвижения. Некорректно настроив цели, владелец сайта теряет контроль над происходящими на ресурсе процессами и не может адекватно оценить конверсию. Такая ситуация может возникать по нескольким причинам:

- при полном игнорировании настроек целей;

- из-за отсутствия проверки кода сайта перед запуском;

- при неправильном выборе настроек.

Последний момент требует особого внимания. К примеру, цель может быть настроена не на отправление формы, а на нажатие кнопки. И если пользователь неправильно внесет данные, аналитика все равно оценит конверсию как успешную, что не соответствует истине.

И дополнительный пункт – это пост-аналитика

Важно не только стремиться к увеличению трафика, но также не забывать анализировать результаты. Делать это необходимо по всем направлениям:

- эффективности внедренных правок;

- поведению посетителей на сайте;

- динамике и сезонных изменениях;

- качественным показателям трафика и т. д.

И все это поддается управлению. Анализируя особенности и поведение целевой аудитории, качество трафика, можно создавать действительно эффективные посадочные страницы, которые продвинут сайт в ТОП.